ソフトウェア開発費の見積り、プロジェクトマネジメント、

発注者と受注者の間の合意形成等に参考となる情報を不定期に掲載していきます。

生成AIが拓くデジタル経営

第4回 AI活用におけるセキュリティとコンプライアンス

株式会社VIVINKO 代表取締役 井上 研一

■AI活用におけるガバナンス構築

前回はITコーディネータ協会の「中小企業向けAI活用ガイド」をもとに、AI活用の

マネジメントを取り上げました。AI活用を組織的に展開する際には、セキュリティ対

策とコンプライアンス(法令遵守)を含めたガバナンス体制の構築が不可欠です。今回

は、ガイドの第4章の内容をもとに、中小企業が取り組むべきAIガバナンスの実践ポ

イントについて解説します。

■「個人」と「組織」の温度差を埋める

個人の業務効率化でChatGPTなどを使っている人は多いものの、組織全体で業務プロ

セスに組み込んでいる企業はまだ少数派です。ITコーディネータとして「社長自身は使

っているが、社員への展開方法が分からない」という相談を受けることは多いものです。

その要因の一つに「ガバナンスとセキュリティ」が整備されていないことがあります。

AI活用に関するルールが決まっていないと、真面目な従業員は「怖いから使わない」

と萎縮し、感度の高い従業員は個人の判断でこっそり使う「シャドーAI」になります。

どちらも組織としては不健全です。

■身の丈に合ったリスク管理

中小企業のガバナンス構築では、「身の丈に合ったスコープ設定」が重要です。まず、

社内文書のたたき台作りや競合調査の要約など、失敗しても被害の小さい低リスクの業

務から始めます。効果と安全性を確認しながら、成功事例を社内で共有し段階的にスコ

ープを拡張することで、リスク管理と費用対効果のバランスを保つことができます。

AI活用における重要なリスクの一つとして、データの学習使用リスクがあります。多く

のAIサービスでは、ユーザーが入力したデータをAIモデルの改善・学習に使用するこ

とがあります。機密情報が学習に使用されると、第三者への情報漏洩につながる可能性

があります。

対策として、まず利用規約とプライバシーポリシーを確認し、データの学習使用に関す

る条項を見落とさないようにします。多くのサービスでは「オプトアウト設定」により

学習使用を拒否できます。

ただし、オプトアウトしても一時的にデータが保持される期間があることや、すべての

サービスでオプトアウトが可能とは限らないことに注意が必要です。機密情報について

は、そもそもAIサービスに入力しないという運用ルールの策定が基本です。

■契約で押さえるべき4つの必須項目

AIサービス導入時の契約では、以下の4つの項目を確認し、法的リスクを回避します。

第一に知的財産権の帰属です。AI生成物の権利が誰に帰属するのかを明確にします。第

二に学習データの合法性保証です。AIが学習したデータが適法に収集されたものであ

ることを事業者が保証しているかを確認します。第三にDPA(データ処理契約)につ

いてです。個人データの取り扱いについて、GDPR等の規制に準拠しているかを確認し

ます。第四に解約時やサービス終了時の退出条項です。データ移行方法や削除手続きが

明確になっていることが重要です。

これらの項目を網羅的にチェックすることで、導入後のトラブルを未然に防ぐことがで

きます。また、経済産業省の「AIの利用・開発に関する契約チェックリスト」には契

約内容について確認するためのチェックリストが提供されているため、活用すると良い

でしょう。

■AI事業者ガイドラインの実践ポイント

総務省・経済産業省は2024年に「AI事業者ガイドライン」を公開しました。このガイ

ドラインではAI事業者として、AIの開発者や提供者だけでなく、事業活動において

AIを利用する者も含まれます。あくまでガイドラインであり、各事業者の自主的な取

り組みによって、安全安心なAI活用が広まることが期待されています。

実践の中核となるのがAIガバナンス体制の整備です。具体的には、AIガバナンスに関

するポリシーの策定と経営者の責任明確化、リスク評価・対応を行う専門チームや責任

者の設置、AI活用状況のモニタリング体制の構築、ステークホルダーへの説明責任を

果たす仕組みの整備が求められます。

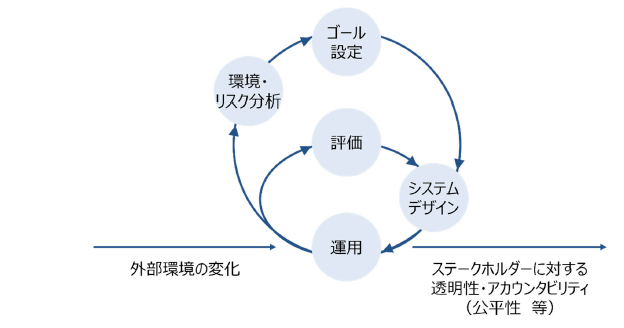

技術の急速な変化に対応するため、リスクベースアプローチを採用し、AIの特性、用

途、社会的影響に応じて対応の程度を調整します。また、アジャイル・ガバナンスの考

え方で「環境・リスク分析」→「ゴール設定」→「システムデザイン」→「運用」→「評

価」のサイクルを継続的に回し、AIガバナンスを組織文化として定着させることが期

待されています。

(出典)総務省・経済産業省「AI事業者ガイドライン」

■実効性のある社内ルール整備

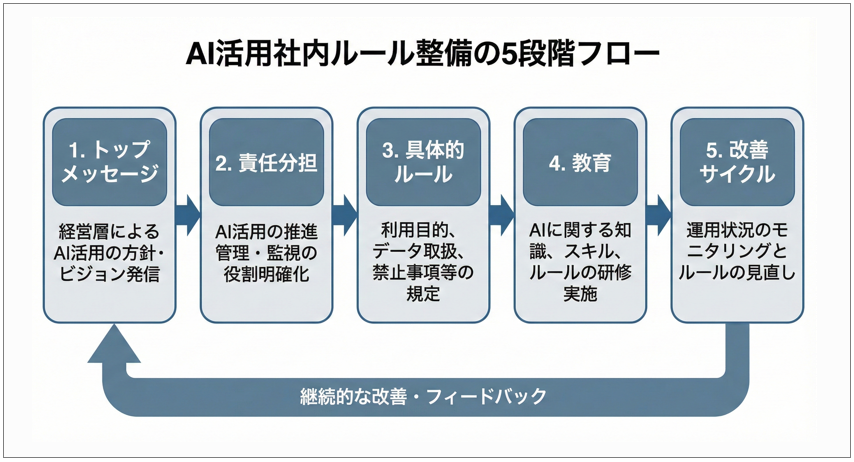

社内ルールを整備するにあたっては、「トップメッセージ→責任分担→具体的ルール→教育→改善サイクル」の体系的な流れで整備し、実効性を確保します。

まず、経営トップからAI活用の方針と重要性を明確に発信します。次に、AI利用の承

認プロセスを確立し、情報システム部門や法務部門の責任範囲を明確にします。

従業員向けには、顧客情報、契約内容、未公開の製品情報などAIに入力してはいけな

い情報を明示し、AI生成物については、そのまま使用せず必ず確認する、出典を確認

するなど取り扱い方法も定めます。また、ID・パスワードの使い回し禁止や多要素認証

の利用などアカウント管理のルールや、退職者のアカウント削除手順といったIT活用

の基本的なルールはAIツールにおいても重要です。

AI事業者ガイドラインにおいてアジャイル・ガバナンスが求められているように、社

内ルールは一度決めれば終わりではありません。ルールが守られているか確認し、一方

でどの程度AI活用が進んでいるかを評価します。新たなAIツールや機能が増えていく

ことを踏まえ、使用するAIツールや適用する業務の見直しを定期的に行うことも重要

です。

このように、組織でのAI活用を拡げるには、セキュリティ対策やガバナンス体制の整

備が鍵を握っています。従業員が安心してAIを活用できる環境を整備することが重要

です。生産性向上とセキュリティのバランスを取りながら、段階的にAI活用を進めて

いきましょう。日本ディープラーニング協会の「生成AIの利用ガイドライン」のひな

形も参考になるでしょう。

次回は「プロンプトエンジニアリングの現在地」として、生成AI活用の基本スキルで

あるプロンプトについて、2025年時点で本当に必要な技術は何かを見極めたいと思い

ます。

※このコラムは全8回を予定しています。

ITコーディネータとして、2016年からAIを業務に組み込む活動を続けている。生成AI利活用クラウドサービス「Gen2Go」を開発・提供するほか、北九州市ロボット・DX推進センターで中小企業のDX支援に携わる。一般社団法人IT経営コンサルティング九州(ITC九州)の理事や、特定非営利活動法人ITコーディネータ協会生成AI研究会のリーダーも務める。